這是2024年的第9篇文章( 本文閱讀時間:15分鐘 )01引言LoRA(Low-rank Adapter)在大模型(如GPT-3,LLama, Qwen等)中,是一種重要的微調技術。該技術通過在不改

機器之心報道機器之心編輯部多模態大型語言模型進展如何?盤點 26 個當前最佳多模態大型語言模型。當前 AI 領域的關註重心正從大型語言模型(LLM)向多模態轉移,於是乎,讓 LLM 具備多模態能力的多

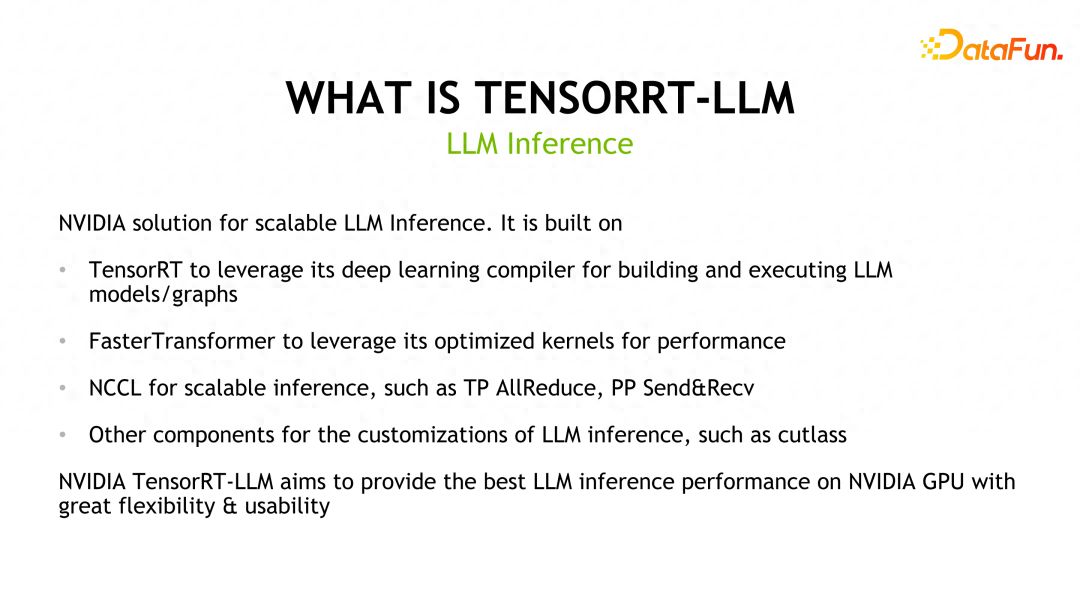

導讀 大傢好,我是來自 NVIDIA 的周國峰,今天給大傢帶來的是關於TensorRT-LLM 推理框架方案的介紹。介紹的主要內容分為如下幾部分:1. TensorRT-LLM 的產品定位2. Ten

編輯:桃子 好困【新智元導讀】大模型幻覺問題還有另一種解法?斯坦福聯手OpenAI研究人員提出「元提示」新方法,能夠讓大模型成為全能「指揮傢」,匯聚不同專傢模型精華,讓GPT-4的輸出更精準。當你讓大

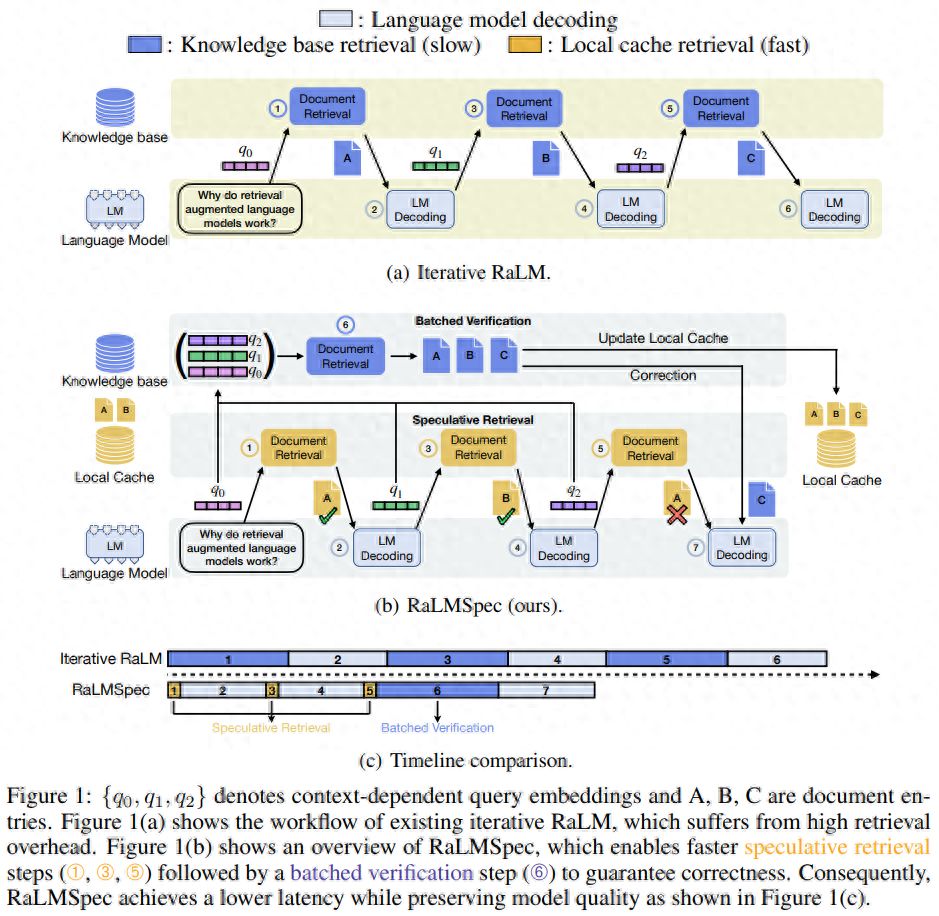

引言:知識密集型NLP任務中的挑戰與RaLM的潛力在知識密集型自然語言處理(NLP)任務中,傳統的大語言模型面臨著將海量知識編碼進全參數化模型的巨大挑戰。這不僅在訓練和部署階段需要大量的努力,而且在模

繼 Redis作者長文總結LLMs, 能夠取代99%的程序員之後。Redis作者今天又開啟AI新征程:首個LLM采樣令牌發佈。項目地址:https://github.com/antirez/LLM-F

一、結論寫在前面論文提出了參數高效的稀疏性改造(Parameter-Efficient Sparsity Crafting,PESC),它利用MoE架構將密集模型升級為稀疏模型。PESC在稀疏模型的M

2023年是AIGC技術發展的元年,隨著LLM(Large Language Model)的快速發展,市場上湧現出越來越多的行業應用,比如前陣子非常火爆的“圖片跳科目三”的應用讓廣大網友玩的樂此不疲。

GTC 2024 大會 China AI Day 線上專場,是 NVIDIA 為國內 AI 開發者、技術領袖和業務決策人舉辦的中文演講系列,將於 3 月 19 日上午 10:00 舉辦。China A

深度學習自然語言處理 原創作者:wkk論文:KNOWLEDGE FUSION OF LARGE LANGUAGE MODELS地址:https://arxiv.org/pdf/2401.10491.p